Файл robots.txt — текстовый файл в формате.txt, ограничивающий поисковым роботам доступ к содержимому на http-сервере. Как определение, Robots.txt — это стандарт исключений для роботов , который был принят консорциумом W3C 30 января 1994 года, и который добровольно использует большинство поисковых систем. Файл robots.txt состоит из набора инструкций для поисковых роботов, которые запрещают индексацию определенных файлов, страниц или каталогов на сайте. Рассмотрим описание robots.txt для случая, когда сайт не ограничивает доступ роботам к сайту.

Простой пример robots.txt:

User-agent: * Allow: /

Здесь роботс полностью разрешает индексацию всего сайта.

Файл robots.txt необходимо загрузить в корневой каталог вашего сайта , чтобы он был доступен по адресу:

Ваш_сайт.ru/robots.txt

Для размещения файла robots.txt в корне сайта обычно необходим доступ через FTP . Однако, некоторые системы управления (CMS) дают возможность создать robots.txt непосредственно из панели управления сайтом или через встроенный FTP-менеджер.

Если файл доступен, то вы увидите содержимое robots.txt в браузере.

Для чего нужен robots.txt

Roots.txt для сайта является важным аспектом . Зачем нужен robots.txt ? Например, в SEO robots.txt нужен для того, чтобы исключать из индексации страницы, не содержащие полезного контента и многое другое . Как, что, зачем и почему исключается уже было описано в статье про , здесь не будем на этом останавливаться. Нужен ли файл robots.txt всем сайтам? И да и нет. Если использование robots.txt подразумевает исключение страниц из поиска, то для небольших сайтов с простой структурой и статичными страницами подобные исключения могут быть лишними. Однако, и для небольшого сайта могут быть полезны некоторые директивы robots.txt , например директива Host или Sitemap, но об этом ниже.

Как создать robots.txt

Поскольку robots.txt — это текстовый файл, и чтобы создать файл robots.txt , можно воспользоваться любым текстовым редактором, например Блокнотом . Как только вы открыли новый текстовый документ, вы уже начали создание robots.txt, осталось только составить его содержимое, в зависимости от ваших требований, и сохранить в виде текстового файла с названием robots в формате txt . Все просто, и создание файла robots.txt не должно вызвать проблем даже у новичков. О том, как составить robots.txt и что писать в роботсе на примерах покажу ниже.

Cоздать robots.txt онлайн

Вариант для ленивых — создать роботс онлайн и скачать файл robots.txt уже в готовом виде. Создание robots txt онлайн предлагает множество сервисов, выбор за вами. Главное — четко понимать, что будет запрещено и что разрешено, иначе создание файла robots.txt online может обернуться трагедией , которую потом может быть сложно исправить. Особенно, если в поиск попадет то, что должно было быть закрытым. Будьте внимательны — проверьте свой файл роботс, прежде чем выгружать его на сайт. Все же пользовательский файл robots.txt точнее отражает структуру ограничений, чем тот, что был сгенерирован автоматически и скачан с другого сайта. Читайте дальше, чтобы знать, на что обратить особое внимание при редактировании robots.txt.

Редактирование robots.txt

После того, как вам удалось создать файл robots.txt онлайн или своими руками, вы можете редактировать robots.txt . Изменить его содержимое можно как угодно, главное — соблюдать некоторые правила и синтаксис robots.txt. В процессе работы над сайтом, файл роботс может меняться, и если вы производите редактирование robots.txt, то не забывайте выгружать на сайте обновленную, актуальную версию файла со всем изменениями. Далее рассмотрим правила настройки файла, чтобы знать, как изменить файл robots.txt и «не нарубить дров».

Правильная настройка robots.txt

Правильная настройка robots.txt позволяет избежать попадания частной информации в результаты поиска крупных поисковых систем. Однако, не стоит забывать, что команды robots.txt не более чем руководство к действию, а не защита . Роботы надежных поисковых систем, вроде Яндекс или Google, следуют инструкциям robots.txt, однако прочие роботы могут легко игнорировать их. Правильное понимание и применение robots.txt — залог получения результата.

Чтобы понять, как сделать правильный robots txt , для начала необходимо разобраться с общими правилами, синтаксисом и директивами файла robots.txt.

Правильный robots.txt начинается с директивы User-agent , которая указывает, к какому роботу обращены конкретные директивы.

Примеры User-agent в robots.txt:

# Указывает директивы для всех роботов одновременно User-agent: * # Указывает директивы для всех роботов Яндекса User-agent: Yandex # Указывает директивы для только основного индексирующего робота Яндекса User-agent: YandexBot # Указывает директивы для всех роботов Google User-agent: Googlebot

Учитывайте, что подобная настройка файла robots.txt указывает роботу использовать только директивы, соответствующие user-agent с его именем.

Пример robots.txt с несколькими вхождениями User-agent:

# Будет использована всеми роботами Яндекса User-agent: Yandex Disallow: /*utm_ # Будет использована всеми роботами Google User-agent: Googlebot Disallow: /*utm_ # Будет использована всеми роботами кроме роботов Яндекса и Google User-agent: * Allow: /*utm_

Директива User-agent создает лишь указание конкретному роботу, а сразу после директивы User-agent должна идти команда или команды с непосредственным указанием условия для выбранного робота. В примере выше используется запрещающая директива «Disallow», которая имеет значение «/*utm_». Таким образом, закрываем все . Правильная настройка robots.txt запрещает наличие пустых переводов строки между директивами «User-agent», «Disallow» и директивами следующими за «Disallow» в рамках текущего «User-agent».

Пример неправильного перевода строки в robots.txt:

Пример правильного перевода строки в robots.txt:

User-agent: Yandex Disallow: /*utm_ Allow: /*id= User-agent: * Disallow: /*utm_ Allow: /*id=

Как видно из примера, указания в robots.txt поступают блоками , каждый из которых содержит указания либо для конкретного робота, либо для всех роботов «*».

Кроме того, важно соблюдать правильный порядок и сортировку команд в robots.txt при совместном использовании директив, например «Disallow» и «Allow». Директива «Allow» — разрешающая директива, является противоположностью команды robots.txt «Disallow» — запрещающей директивы.

Пример совместного использования директив в robots.txt:

User-agent: * Allow: /blog/page Disallow: /blog

Данный пример запрещает всем роботам индексацию всех страниц, начинающихся с «/blog», но разрешает индексации страниц, начинающиеся с «/blog/page».

Прошлый пример robots.txt в правильной сортировке:

User-agent: * Disallow: /blog Allow: /blog/page

Сначала запрещаем весь раздел, потом разрешаем некоторые его части.

Еще один правильный пример robots.txt с совместными директивами:

User-agent: * Allow: / Disallow: /blog Allow: /blog/page

Обратите внимание на правильную последовательность директив в данном robots.txt.

Директивы «Allow» и «Disallow» можно указывать и без параметров, в этом случае значение будет трактоваться обратно параметру «/».

Пример директивы «Disallow/Allow» без параметров:

User-agent: * Disallow: # равнозначно Allow: / Disallow: /blog Allow: /blog/page

Как составить правильный robots.txt и как пользоваться трактовкой директив — ваш выбор. Оба варианта будут правильными. Главное — не запутайтесь.

Для правильного составления robots.txt необходимо точно указывать в параметрах директив приоритеты и то, что будет запрещено для скачивания роботам. Более полно использование директив «Disallow» и «Allow» мы рассмотрим чуть ниже, а сейчас рассмотрим синтаксис robots.txt. Знание синтаксиса robots.txt приблизит вас к тому, чтобы создать идеальный robots txt своими руками .

Синтаксис robots.txt

Роботы поисковых систем добровольно следуют командам robots.txt — стандарту исключений для роботов, однако не все поисковые системы трактуют синтаксис robots.txt одинаково. Файл robots.txt имеет строго определённый синтаксис, но в то же время написать robots txt не сложно, так как его структура очень проста и легко понятна.

Вот конкретные список простых правил, следуя которым, вы исключите частые ошибки robots.txt :

- Каждая директива начинается с новой строки;

- Не указывайте больше одной директивы в одной строке;

- Не ставьте пробел в начало строки;

- Параметр директивы должен быть в одну строку;

- Не нужно обрамлять параметры директив в кавычки;

- Параметры директив не требуют закрывающих точки с запятой;

- Команда в robots.txt указывается в формате — [Имя_директивы]:[необязательный пробел][значение][необязательный пробел];

- Допускаются комментарии в robots.txt после знака решетки #;

- Пустой перевод строки может трактоваться как окончание директивы User-agent;

- Директива «Disallow: » (с пустым значением) равнозначна «Allow: /» — разрешить все;

- В директивах «Allow», «Disallow» указывается не более одного параметра;

- Название файла robots.txt не допускает наличие заглавных букв, ошибочное написание названия файла — Robots.txt или ROBOTS.TXT;

- Написание названия директив и параметров заглавными буквами считается плохим тоном и если по стандарту, robots.txt и нечувствителен к регистру, часто к нему чувствительны имена файлов и директорий;

- Если параметр директивы является директорией, то перед название директории всегда ставится слеш «/», например: Disallow: /category

- Слишком большие robots.txt (более 32 Кб) считаются полностью разрешающими, равнозначными «Disallow: »;

- Недоступный по каким-либо причинам robots.txt может трактоваться как полностью разрешающий;

- Если robots.txt пустой, то он будет трактоваться как полностью разрешающий;

- В результате перечисления нескольких директив «User-agent» без пустого перевода строки, все последующие директивы «User-agent», кроме первой, могут быть проигнорированы;

- Использование любых символов национальных алфавитов в robots.txt не допускается.

Поскольку разные поисковые системы могут трактовать синтаксис robots.txt по-разному, некоторые пункты можно опустить. Так например, если прописать несколько директив «User-agent» без пустого перевода строки, все директивы «User-agent» будут восприняты корректно Яндексом, так как Яндекс выделяет записи по наличию в строке «User-agent».

В роботсе должно быть указано строго только то, что нужно, и ничего лишнего. Не думайте, как прописать в robots txt все , что только можно и чем его заполнить. Идеальный robots txt — это тот, в котором меньше строк, но больше смысла. «Краткость — сестра таланта». Это выражение здесь как нельзя кстати.

Как проверить robots.txt

Для того, чтобы проверить robots.txt на корректность синтаксиса и структуры файла, можно воспользоваться одной из онлайн-служб. К примеру, Яндекс и Google предлагают собственные сервисы для вебмастеров, которые включают анализ robots.txt:

Проверка файла robots.txt в Яндекс.Вебмастер: http://webmaster.yandex.ru/robots.xml

Для того, чтобы проверить robots.txt онлайн необходимо загрузить robots.txt на сайт в корневую директорию . Иначе, сервис может сообщить, что не удалось загрузить robots.txt . Рекомендуется предварительно проверить robots.txt на доступность по адресу где лежит файл, например: ваш_сайт.ru/robots.txt.

Кроме сервисов проверки от Яндекс и Google, существует множество других онлайн валидаторов robots.txt.

Robots.txt vs Яндекс и Google

Есть субъективное мнение, что указание отдельного блока директив «User-agent: Yandex» в robots.txt Яндекс воспринимает более позитивно, чем общий блок директив с «User-agent: *». Аналогичная ситуация robots.txt и Google. Указание отдельных директив для Яндекс и Google позволяет управлять индексацией сайта через robots.txt. Возможно, им льстит персонально обращение, тем более, что для большинства сайтов содержимое блоков robots.txt Яндекса, Гугла и для других поисковиков будет одинаково. За редким исключением, все блоки «User-agent» будут иметь стандартный для robots.txt набор директив. Так же, используя разные «User-agent» можно установить запрет индексации в robots.txt для Яндекса , но, например не для Google.

Отдельно стоит отметить, что Яндекс учитывает такую важную директиву, как «Host», и правильный robots.txt для яндекса должен включать данную директиву для указания главного зеркала сайта. Подробнее директиву «Host» рассмотрим ниже.

Запретить индексацию: robots.txt Disallow

Disallow — запрещающая директива , которая чаще всего используется в файле robots.txt. Disallow запрещает индексацию сайта или его части, в зависимости от пути, указанного в параметре директивы Disallow.

Пример как в robots.txt запретить индексацию сайта:

User-agent: * Disallow: /

Данный пример закрывает от индексации весь сайт для всех роботов.

В параметре директивы Disallow допускается использование специальных символов * и $:

* — любое количество любых символов, например, параметру /page* удовлетворяет /page, /page1, /page-be-cool, /page/kak-skazat и т.д. Однако нет необходимости указывать * в конце каждого параметра, так как например, следующие директивы интерпретируются одинаково:

User-agent: Yandex Disallow: /page User-agent: Yandex Disallow: /page*

$ — указывает на точное соответствие исключения значению параметра:

User-agent: Googlebot Disallow: /page$

В данном случае, директива Disallow будет запрещать /page, но не будет запрещать индексацию страницы /page1, /page-be-cool или /page/kak-skazat.

Если закрыть индексацию сайта robots.txt , в поисковые системы могут отреагировать на так ход ошибкой «Заблокировано в файле robots.txt» или «url restricted by robots.txt» (url запрещенный файлом robots.txt). Если вам нужно запретить индексацию страницы , можно воспользоваться не только robots txt, но и аналогичными html-тегами:

- - не индексировать содержимое страницы;

- - не переходить по ссылкам на странице;

- - запрещено индексировать содержимое и переходить по ссылкам на странице;

- — аналогично content=»none».

Разрешить индексацию: robots.txt Allow

Allow — разрешающая директива и противоположность директиве Disallow. Эта директива имеет синтаксис, сходный с Disallow.

Пример, как в robots.txt запретить индексацию сайта кроме некоторых страниц:

User-agent: * Disallow: / Allow: /page

Запрещается индексировать весь сайт , кроме страниц, начинающихся с /page.

Disallow и Allow с пустым значением параметра

Пустая директива Disallow:

User-agent: * Disallow:

Не запрещать ничего или разрешить индексацию всего сайта и равнозначна:

User-agent: * Allow: /

Пустая директива Allow:

User-agent: * Allow:

Разрешить ничего или полный запрет индексации сайта, равнозначно:

User-agent: * Disallow: /

Главное зеркало сайта: robots.txt Host

Директива Host служит для указания роботу Яндекса главного зеркала Вашего сайта . Из всех популярных поисковых систем, директива Host распознаётся только роботами Яндекса . Директива Host полезна в том случае, если ваш сайт доступен по нескольким , например:

Mysite.ru mysite.com

Или для определения приоритета между:

Mysite.ru www.mysite.ru

Роботу Яндекса можно указать, какое зеркало является главным . Директива Host указывается в блоке директивы «User-agent: Yandex» и в качестве параметра, указывается предпочтительный адрес сайта без «http://».

Пример robots.txt с указанием главного зеркала:

User-agent: Yandex Disallow: /page Host: mysite.ru

В качестве главного зеркала указывается доменное имя mysite.ru без www. Таки образом, в результатах поиска буде указан именно такой вид адреса.

User-agent: Yandex Disallow: /page Host: www.mysite.ru

В качестве основного зеркала указывается доменное имя www.mysite.ru.

Директива Host в файле robots.txt может быть использована только один раз, если же директива Хост будет указана более одного раза, учитываться будет только первая, прочие директивы Host будут игнорироваться.

Если вы хотите указать главное зеркало для робота Google, воспользуйтесь сервисом Google Инструменты для вебмастеров.

Карта сайта: robots.txt sitemap

При помощи директивы Sitemap, в robots.txt можно указать расположение на сайте .

Пример robots.txt с указанием адреса карты сайта:

User-agent: * Disallow: /page Sitemap: http://www.mysite.ru/sitemap.xml

Указание адреса карты сайта через директиву Sitemap в robots.txt позволяет поисковому роботу узнать о наличии карты сайта и начать ее индексацию.

Директива Clean-param

Директива Clean-param позволяет исключить из индексации страницы с динамическими параметрами. Подобные страницы могут отдавать одинаковое содержимое, имея различные URL страницы. Проще говоря, будто страница доступна по разным адресам. Наша задача убрать все лишние динамические адреса, которых может быть миллион. Для этого исключаем все динамические параметры, используя в robots.txt директиву Clean-param .

Синтаксис директивы Clean-param:

Clean-param: parm1[&parm2&parm3&parm4&..&parmn] [Путь]

Рассмотрим на примере страницы со следующим URL:

Www.mysite.ru/page.html?&parm1=1&parm2=2&parm3=3

Пример robots.txt Clean-param:

Clean-param: parm1&parm2&parm3 /page.html # только для page.html

Clean-param: parm1&parm2&parm3 / # для всех

Директива Crawl-delay

Данная инструкция позволяет снизить нагрузку на сервер, если роботы слишком часто заходят на ваш сайт. Данная директива актуальна в основном для сайтов с большим объемом страниц.

Пример robots.txt Crawl-delay:

User-agent: Yandex Disallow: /page Crawl-delay: 3

В данном случае мы «просим» роботов яндекса скачивать страницы нашего сайта не чаще, чем один раз в три секунды. Некоторые поисковые системы поддерживают формат дробных чисел в качестве параметра директивы Crawl-delay robots.txt .

Иногда нужно, чтобы страницы сайта или размещенные на них ссылки не появлялись в результатах поиска. Скрыть содержимое сайта от индексирования можно с помощью файла robots.txt , HTML-разметки или авторизации на сайте.

Запрет индексирования сайта, раздела или страницы

Если какие-то страницы или разделы сайта не должны индексироваться (например, со служебной или конфиденциальной информацией), ограничьте доступ к ним следующими способами:

Используйте авторизацию на сайте. Рекомендуем этот способ, чтобы скрыть от индексирования главную страницу сайта. Если главная страница запрещена в файле robots.txt или с помощью метатега noindex , но на нее ведут ссылки, страница может попасть в результаты поиска.

Запрет индексирования контента страницы

Скрыть от индексирования часть текста страницыВ HTML-коде страницы добавьте элемент noindex . Например:

Элемент не чувствителен к вложенности - может находиться в любом месте HTML-кода страницы. При необходимости сделать код сайта валидным возможно использование тега в следующем формате:

текст, индексирование которого нужно запретить Скрыть от индексирования ссылку на странице

В HTML-коде страницы в элемент a добавьте атрибут . Например:

Атрибут работает аналогично директиве nofollow в метатеге robots , но распространяется только на ссылку, для которой указан.

Robots.txt для wordpress один из главных инструментов настройки индексации. Ранее мы говорили об ускорении и улучшении процесса индексации статей. Причем рассматривали этот вопрос так, как будто поисковый робот ничего не знает и не умеет. А мы ему должны подсказать. Для этого мы использовали карту сайта файл .

Возможно вы еще не догадывается, как поисковый робот индексирует ваш сайт? По умолчанию индексировать ему разрешено всё. Но делает он это не сразу. Робот, получив сигнал о том, что нужно посетить сайт, ставит его в очередь. Поэтому индексация происходит не мгновенно по нашему требованию, а через какое-то время. Как только очередь доходит до вашего сайта, этот робот-паук тут как тут. Первым делом он ищет файл robots.txt.

Если robots.txt найден, то прочитывает все директивы, а в конце видит адрес файла . Дальше робот, в соответствии с картой сайта, обходит все материалы предоставленные для индексации. Делает он это в пределах какого-то ограниченного промежутка времени. Именно поэтому, если вы создали сайт на несколько тысяч страниц и выложили его целиком, то робот просто не успеет обойти все страницы за один заход. И в индекс попадут только те, которые он успел просмотреть. А ходит робот по всему сайту и тратит на это свое время. И не факт что в первую очередь он будет просматривать именно те странички, которые вы так ждёте в результатах поиска.

Если робот файл robots.txt не находит, то считает, что индексировать разрешено всё. И начинает шарить по всем закаулкам. Сделав полную копию всего, что ему удалось найти, он покидает ваш сайт, до следующего раза. Как вы понимаете, после такого обшаривания в базу индекса поисковика попадает всё, что надо и всё, что не надо. То что надо вы знаете - это ваши статьи, страницы, картинки, ролики и т.д. А вот чего индексировать не надо?

Для WordPress это оказывается очень важный вопрос. Ответ на него затрагивает и ускорение индексации содержимого вашего сайта, и его безопасность. Дело в том, что всю служебную информацию индексировать не надо. А файлы WordPress вообще желательно спрятать от чужих глаз. Это уменьшит вероятность взлома вашего сайта.

WordPress создаёт очень много копий ваших статей с разными адресами, но одним и тем же содержанием. Выглядит это так:

//название_сайта/название_статьи,

//название_сайта/название_рубрики/название_статьи,

//название_сайта/название_рубрики/название_подрубрики/название_статьи,

//название_сайта/название_тега/название_статьи,

//название_сайта/дата_создания_архива/название_статьи

С тегами и архивами вообще караул. К скольким тегам привязана статья, столько копий и создаётся. При редактировании статьи, сколько архивов в разные даты будет создано, столько и новых адресов с практически похожим содержанием появится. А есть ещё копии статей с адресами для каждого комментария. Это вообще просто ужас.

Огромное количество дублей поисковые системы оценивают как плохой сайт. Если все эти копии проиндексировать и предоставить в поиске то вес главной статьи размажется на все копии, что очень плохо. И не факт, что будет показана в результате поиска именно статья с главным адресом. Следовательно надо запретить индексирование всех копий.

WordPress оформляет картинки как отдельные статьи без текста. В таком виде без текста и описания они как статьи выглядят абсолютно некорректно. Следовательно нужно принять меры чтобы эти адреса не попали в индекс поисковиков.

Почему же не надо всё это индексировать?

Пять причин для запрета индексации!

- Полное индексирование создаёт лишнюю нагрузку на ваш сервер.

- Отнимает драгоценное время самого робота.

- Пожалуй это самое главное, некорректная информация может быть неправильно интерпретирована поисковыми системами. Это приведет к неправильному ранжированию статей и страниц, а в последствии и к некорректной выдаче в результатах поиска.

- Папки с шаблонами и плагинами содержат огромное количество ссылок на сайты создателей и рекламодателей. Это очень плохо для молодого сайта, когда на ваш сайт ссылок из вне еще нет или очень мало.

- Индексируя все копии ваших статей в архивах и комментариях, у поисковика складывается плохое мнение о вашем сайте. Много дублей. Много исходящих ссылок Поисковая машина будет понижать ваш сайт в результатах поиска в плоть до фильтра. А картинки, оформленные в виде отдельной статьи с названием и без текста, приводят робота просто в ужас. Если их очень много, то сайт может загреметь под фильтр АГС Яндекса. Мой сайт там был. Проверено!

Теперь после всего сказанного возникает резонный вопрос: "А можно ли как то запретить индексировать то что не надо?". Оказывается можно. Хотя бы не в приказном порядке, а в рекомендательном. Ситуация не полного запрета индексации некоторых объектов возникает из-за файла sitemap.xml, который обрабатывается после robots.txt. Получается так: robots.txt запрещает, а sitemap.xml разрешает. И всё же решить эту задачу мы можем. Как это сделать правильно сейчас и рассмотрим.

Файл robots.txt для wordpress по умолчанию динамический и реально в wordpress не существует. А генерируется только в тот момент, когда его кто-то запрашивает, будь это робот или просто посетитель. То есть если через FTP соединение вы зайдете на сайт, то в корневой папке файла robots.txt для wordpressвы там просто не найдете. А если в браузере укажите его конкретный адрес http://название_вашего_сайта/robots.txt, то на экране получите его содержимое, как будто файл существует. Содержимое этого сгенерированного файла robots.txt для wordpress будет такое:

В правилах составления файла robots.txt по умолчанию разрешено индексировать всё. Директива User-agent: * указывает на то, что все последующие команды относятся ко всем поисковым агентам (*). Но далее ничего не ограничивается. И как вы понимаете этого не достаточно. Мы с вами уже обсудили папок и записей, имеющих ограниченный доступ, достаточно много.

Чтобы можно было внести изменения в файл robots.txt и они там сохранились, его нужно создать в статичном постоянном виде.

Как создать robots.txt для wordpress

В любом текстовом редакторе (только ни в коем случае не используйте MS Word и ему подобные с элементами автоматического форматирования текста) создайте текстовый файл с примерным содержимым приведенным ниже и отправьте его в корневую папку вашего сайта. Изменения можно делать в зависимости от необходимости.

Только надо учитывать особенности составления файла:

В начале строк цифр, как здесь в статье, быть не должно. Цифры здесь указаны для удобства рассмотрения содержимого файла. В конце каждой строки не должно быть ни каких лишних знаков включая пробелы или табуляторы. Между блоками должна быть пустая строка без каких либо знаков включая пробелы. Всего один пробел может принести вам огромный вред - БУДЬТЕ ВНИМАТЕЛЬНЫ .

Как проверить robots.txt для wordpress

Проверить robots.txt на наличие лишних пробелов можно следующим образом. В текстовом редакторе выделить весь текст, нажав кнопки Ctrl+A. Если пробелов в конце строк и в пустых строках нет, вы это заметите. А если есть выделенная пустота, то вам надо убрать пробелы и всё будет ОК.

Проверить правильно ли работают прописанные правила можно по следующим ссылкам:

- Анализ robots.txt в Яндекс Вебмастере

- Анализ robots.txt в Google Search console .

- Сервис для создания файла robots.txt: http://pr-cy.ru/robots/

- Сервис для создания и проверки robots.txt: https://seolib.ru/tools/generate/robots/

- Документация от Яндекса .

- Документация от google (англ.)

Есть ещё один способ проверить файл robots.txt для сайта wordpress, это загрузить его содержимое в вебмастер яндекса или указать адрес его расположения. Если есть какие-либо ошибки вы тут же узнаете.

Правильный robots.txt для wordpress

Теперь давайте перейдем непосредственно к содержимому файла robots.txt для сайта wordpress. Какие директивы в нем должны присутствовать обязательно. Примерное содержание файла robots.txt для wordpress, учитывая его особенности приведено ниже:

User-agent: * Disallow: /wp-login.php Disallow: /wp-admin Disallow: /wp-includes Disallow: /wp-content/plugins Disallow: /wp-content/themes Disallow: */*comments Disallow: */*category Disallow: */*tag Disallow: */trackback Disallow: */*feed Disallow: /*?* Disallow: /?s= Allow: /wp-admin/admin-ajax.php Allow: /wp-content/uploads/ Allow: /*?replytocom User-agent: Yandex Disallow: /wp-login.php Disallow: /wp-admin Disallow: /wp-includes Disallow: /wp-content/plugins Disallow: /wp-content/themes Disallow: */comments Disallow: */*category Disallow: */*tag Disallow: */trackback Disallow: */*feed Disallow: /*?* Disallow: /*?s= Allow: /wp-admin/admin-ajax.php Allow: /wp-content/uploads/ Allow: /*?replytocom Crawl-delay: 2,0 Host: site.ru Sitemap: http://site.ru/sitemap.xml

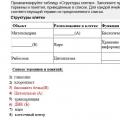

Директивы файла robots.txt для wordpress

Теперь давайте рассмотрим поподробнее:

1 – 16 строки блок настроек для всех роботов

User-agent: - Это обязательная директива, определяющая поискового агента. Звездочка говорит, что директива для роботов всех поисковых систем. Если блок предназначен для конкретного робота, то необходимо указать его имя, например Yandex, как в 18 строке.

По умолчанию для индексирования разрешено всё. Это равнозначно директиве Allow: /.

Поэтому для запрета индексирования конкретных папок или файлов используется специальная директива Disallow: .

В нашем примере с помощью названий папок и масок названий файлов, сделан запрет на все служебные папки вордпресса, такие как admin, themes, plugins, comments, category, tag... Если указать директиву в таком виде Disallow: /, то будет дан запрет индексирования всего сайта.

Allow: - как я уже говорил директива разрешающая индексирование папок или файлов. Её нужно использовать когда в глубине запрещённых папок есть файлы которые всё же надо проиндексировать.

В моём примере строка 3 Disallow: /wp-admin - запрещает индексирование папки /wp-admin, а 14 строка Allow: /wp-admin/admin-ajax.php - разрешает индексирование файла /admin-ajax.php расположенного в запрещенной к индексированию папке /wp-admin/.

17 - Пустая строка (просто нажатие кнопки Enter без пробелов)

18 - 33 блок настроек конкретно для агента Яндекса (User-agent: Yandex). Как вы заметили этот блок полностью повторяет все команды предыдущего блока. И возникает вопрос: "А на фига такая заморочка?". Так вот это всё сделано всего лишь из-за нескольких директив которые рассмотрим дальше.

34 - Crawl-delay - Необязательная директива только для Яндекса. Используется когда сервер сильно нагружен и не успевает отрабатывать запросы робота. Она позволяет задать поисковому роботу минимальную задержку (в секундах и десятых долях секунды) между окончанием загрузки одной страницы и началом загрузки следующей. Максимальное допустимое значение 2,0 секунды. Добавляется непосредственно после директив Disallow и Allow.

35 - Пустая строка

36 - Host: site.ru - доменное имя вашего сайта (ОБЯЗАТЕЛЬНАЯ директива для блока Яндекса). Если наш сайт использует протокол HTTPS, то адрес надо указывать полностью как показано ниже:

Host: https://site.ru

37 - Пустая строка (просто нажатие кнопки Enter без пробелов) обязательно должна присутствовать.

38 - Sitemap: http://site.ru/sitemap.xml - адрес расположения файла (файлов) карты сайта sitemap.xml (ОБЯЗАТЕЛЬНАЯ директива), располагается в конце файла после пустой строки и относится ко всем блокам.

Маски к директивам файла robots.txt для wordpress

Теперь немного как создавать маски:

- Disallow: /wp-register.php - Запрещает индексировать файл wp-register.php, расположенный в корневой папке.

- Disallow: /wp-admin - запрещает индексировать содержимое папки wp-admin, расположенной в корневой папке.

- Disallow: /trackback - запрещает индексировать уведомления.

- Disallow: /wp-content/plugins - запрещает индексировать содержимое папки plugins, расположенной в подпапке (папке второго уровня) wp-content.

- Disallow: /feed - запрещает индексировать канал feed т.е. закрывает RSS канал сайта.

- * - означает любая последовательность символов, поэтому может заменять как один символ, так и часть названия или полностью название файла или папки. Отсутствие конкретного названия в конце равносильно написанию *.

- Disallow: */*comments - запрещает индексировать содержимое папок и файлов в названии которых присутствует comments и расположенных в любых папках. В данном случае запрещает индексировать комментарии.

- Disallow: *?s= - запрещает индексировать страницы поиска

Приведенные выше строки вполне можно использовать в качестве рабочего файла robots.txt для wordpress. Только в 36, 38 строках необходимо вписать адрес вашего сайта и ОБЯЗАТЕЛЬНО УБРАТЬ номера строк. И у вас получится рабочий файл robots.txt для wordpress, адаптированный под любую поисковую систему.

Единственная особенность - размер рабочего файла robots.txt для сайта wordpress не должен превышать 32 кБ дискового пространства.

Если вас абсолютно не интересует Яндекс, то строки 18-35 вам не понадобятся вообще. На этом пожалуй всё. Надеюсь что статья оказалась полезной. Если есть вопросы пишите в комментариях.

ROBOTS.TXT - Стандарт исключений для роботов - файл в текстовом формате.txt для ограничения доступа роботам к содержимому сайта. Файл должен находиться в корне сайта (по адресу /robots.txt). Использование стандарта необязательно, но поисковые системы следуют правилам, содержащимся в robots.txt. Сам файл состоит из набора записей вида

:где поле - название правила (User-Agent, Disallow, Allow и проч.)

Записи разделяются одной или более пустых строк (признак конца строки: символы CR, CR+LF, LF)

Как правильно настроить ROBOTS.TXT?

В данном пункте приведены основные требования по настройке файла, конкретные рекомендации по настройке , примеры для популярных CMS

- Размер файла не должен превышать 32 кБ.

- Должна использоваться кодировка ASCII или UTF-8.

- В правильном файле robots.txt должны обязательно присутствовать хотя бы одно правило, состоящие из нескольких директив. Каждое правило обязательно должно содержать следующие директивы:

- для какого робота данное правило (директива User-agent)

- к каким ресурсам у данного агента есть доступ (директива Allow), либо к каким ресурсам нет доступа (Disallow).

- Каждое правило и директива должны начинаться с новой строки.

- Значение правила Disallow/Allow должно начинаться либо с символа /, либо с *.

- Все строки, начинающиеся с символа #, либо части строк начиная с данного символа считаются комментариями и не учитываются агентами.

Таким образом минимальное содержание правильно настроенного файла robots.txt выглядит так:

User-agent: * #для всех агентов Disallow: #запрещено ничего = разрешен доступ ко всем файлам

Как создать/изменить ROBOTS.TXT?

Создать файл возможно с помощью любого текстового редактора (например, notepad++). Для создание либо изменения файла robots.txt обычно требуется доступ к серверу по FTP/SSH, впрочем, многие CMS/CMF имеют встроенный интерфейс управления содержимым файла через панель администрирования (“админку”), например: Bitrix, ShopScript и другие.

Для чего нужен файл ROBOTS.TXT на сайте?

Как видно из определения, robots.txt позволяет управлять поведением роботов при посещении сайта, т.е. настроить индексирование сайта поисковыми системами - это делает данный файл важной частью SEO-оптимизации вашего сайта. Самая важная возможность robots.txt - запрет на индексацию страниц/файлов несодержащих полезную информацию. Либо вообще всего сайта, что может быть необходимо, например, для тестовых версий сайта.

Основные примеры того, что нужно закрывать от индексации будут рассмотрены ниже.

Что нужно закрывать от индексации?

Во-первых, всегда следует запрещать индексация сайтов в процессе разработки, чтобы избежать попадания в индекс страниц, которых вообще не будет на готовой версии сайта и страниц с отсутствующим/дублированным/тестовым контентом до того как они будут заполнены.

Во-вторых, следует скрыть от индексации копии сайта, созданные как тестовые площадки для разработки.

В-третьих, разберем какой контент непосредственно на сайте нужно запрещать индексировать.

- Административная часть сайта, служебные файлы.

- Страницы авторизации/регистрации пользователя, в большинстве случаев - персональные разделы пользователей (если не предусмотрен публичный доступ к личным страницам).

- Корзина и страницы оформления, просмотра заказа.

- Страницы сравнения товаров, возможно выборочно открывать такие страницы для индексации при условии их уникальности. В общем случае таблицы сравнения - бессчетное количество страниц с дублированным контентом.

- Страницы поиска и фильтрации возможно оставлять открытыми для индексации только в случае их правильной настройки: отдельные урлы, заполненные уникальные заголовки, мета-теги. В большинстве случаев такие страницы следует закрывать.

- Страницы с сортировками товаров/записей, в случае наличия у них разных адресов.

- Страницы с utm-, openstat-метками в URl (а также всеми прочими).

Синтаксис ROBOTS.TXT

Теперь остановимся на синтаксисе robots.txt более подробно.

Общие положения:

- каждая директива должна начинаться с новой строки;

- строка не должна начинаться с пробела;

- значение директивы должно быть в одну строку;

- не нужно обрамлять значения директив в кавычки;

- по умолчанию для всех значений директив в конце прописывается *, Пример: User-agent: Yandex Disallow: /cgi-bin* # блокирует доступ к страницам Disallow: /cgi-bin # то же самое

- пустой перевод строки трактуется как окончание правила User-agent;

- в директивах «Allow», «Disallow» указывается только одно значение;

- название файла robots.txt не допускает наличие прописных букв;

- robots.txt размером более 32 Кб не допускается, роботы не будут загружать такой файл и посчитают сайт полностью разрешенным;

- недоступный robots.txt может трактовуется как полностью разрешающий;

- пустой robots.txt считается полностью разрешающим;

- для указания кириллических значений правил используйте Punycod;

- допускаются только кодировки UTF-8 и ASCII: использование любых национальных алфавитов и прочих символов в robots.txt не допускается.

Специальные символы:

- #

Символ начала комментирования, весь текст после # и до перевода строки считается комментарием и не используется роботами.

*Подстановочное значение обозначающее префикс, суффикс либо значение директивы полностью - любой набор символов (в том числе пустой).

- $

Указание на конец строки, запрет достраивания * к значению, наПример:

User-agent: * #для всех Allow: /$ #разрешить индексацию главной страницы Disallow: * #запретить индексацию всех страниц, кроме разрешенной

Список директив

- User-agent

Обязательная директива. Определяет к какому роботу относится правило, в правиле может быть одна или несколько таких директив. Можно использовать символ * как указание префикса, суффикса или полного названия робота. Пример:

#сайт закрыт для Google.Новости и Google.Картинки User-agent: Googlebot-Image User-agent: Googlebot-News Disallow: / #для всех роботов, чье название начинается с Yandex, закрываем раздел “Новости” User-agent: Yandex* Disallow: /news #открыт для всех остальных User-agent: * Disallow:

- Disallow

Директива указывает какие файлы или каталоги нельзя индексировать. Значение директивы должно начинаться с символа / либо *. По умолчанию в конце значения проставляется *, если это не запрещено символом $.

- Allow

В каждом правиле должна быть по крайней мере одна директива Disallow: или Allow:.

Директива указывает какие файлы или каталоги следует индексировать. Значение директивы должно начинаться с символа / либо *. По умолчанию в конце значения проставляется *, если это не запрещено символом $.

Использование директивы актуально только совместно с Disallow для разрешения индексации какого-то подмножества запрещенных к индексированию страниц директивой Disallow.

- Clean-param

Необязательная, межсекционная директива. Используйте директиву Clean-param, если адреса страниц сайта содержат GET-параметры (в URL отображается после знака?), которые не влияют на их содержимое (например, UTM). С помощью данного правила все адреса будут приведены к единому виду - исходному, без параметров.

Синтаксис директивы:

Clean-param: p0[&p1&p2&..&pn]

p0… - названия параметров, которые не нужно учитывать

path - префикс пути страниц, для которых применяется правилоПример.

на сайте есть страницы вида

Www.example.com/some_dir/get_book.pl?ref=site_1&book_id=123 www.example.com/some_dir/get_book.pl?ref=site_2&book_id=123 www.example.com/some_dir/get_book.pl?ref=site_3&book_id=123

При указании правила

User-agent: Yandex Disallow: Clean-param: ref /some_dir/get_book.pl

робот сведет все адреса страницы к одному:

Www.example.com/some_dir/get_book.pl?book_id=123

- Sitemap

Необязательная директива, возможно размещение нескольких таких директив в одном файле, межсекционная (достаточно указать в файле один раз, не дублируя для каждого агента).

Пример:

Sitemap: https://example.com/sitemap.xml

- Crawl-delay

Директива позволяет задать поисковому роботу минимальный период времени (в секундах) между окончанием загрузки одной страницы и началом загрузки следующей. Поддерживаются дробные значения

Минимально допустимое значение для роботов Яндекс - 2.0.

Роботы Google не учитывают данную директиву.

Пример:

User-agent: Yandex Crawl-delay: 2.0 # задает тайм-аут в 2 секунды User-agent: * Crawl-delay: 1.5 # задает тайм-аут в 1.5 секунды

- Host

Директива указывает главное зеркало сайта. На данный момент из популярных поисковых систем поддерживается только Mail.ru.

Пример:

User-agent: Mail.Ru Host: www.site.ru # главное зеркало с www

Примеры robots.txt для популярных CMS

ROBOTS.TXT для 1С:Битрикс

В CMS Битрикс предусмотрена возможность управления содержимым файла robots.txt. Для этого в административном интерфейсе нужно зайти в инструмент “Настройка robots.txt”, воспользовавшись поиском, либо по пути Маркетинг->Поисковая оптимизация->Настройка robots.txt. Также можно изменить содержимое robots.txt через встроенный редактор файлов Битрикс, либо через FTP.

Приведенный ниже пример может использоваться как стартовый набор robots.txt для сайтов на Битрикс, но не является универсальным и требует адаптации в зависимости сайта.

Пояснения:

- разбиение на правила для разных агентов обусловлено тем, что Google не поддерживает директиву Clean-param.

ROBOTS.TXT для WordPress

В “админке” Вордпресс нет встроенного инструмента для настройки robots.txt, поэтому доступ к файлу возможен только с помощью FTP, либо после установки специального плагина (например, DL Robots.txt).

Приведенный ниже пример может использоваться как стартовый набор robots.txt для сайтов на Wordpress, но не является универсальным и требует адаптации в зависимости сайта.

Пояснения:

- в директивах Allow указаны пути к файлам стилей, скриптов, картинок: для правильной индексации сайта необходимо, чтобы они были доступны роботам;

- для большинства сайтов страницы архивов записей по автору и меток только создают дублирование контента и не создают полезного контента, поэтому в данном примере они закрыты для индексации. Если же на вашем проекте подобные страницы необходимы, полезны и уникальны, то следует удалить директивы Disallow: /tag/ и Disallow: /author/.

Пример правильного ROBOTS.TXT для сайта на WoRdPress:

User-agent: Yandex # Для Яндекса Disallow: /cgi-bin Disallow: /? Disallow: /wp- Disallow: *?s= Disallow: *&s= Disallow: /search/ Disallow: /author/ Disallow: /users/ Disallow: */trackback Disallow: */feed Disallow: */rss Disallow: */embed Disallow: /xmlrpc.php Disallow: /tag/ Disallow: /readme.html Disallow: *?replytocom Allow: */uploads Allow: /*/*.js Allow: /*/*.css Allow: /wp-*.png Allow: /wp-*.jpg Allow: /wp-*.jpeg Allow: /wp-*.gif Clean-Param: utm_source&utm_medium&utm_campaign Clean-Param: openstat User-agent: * Disallow: /cgi-bin Disallow: /? Disallow: /wp- Disallow: *?s= Disallow: *&s= Disallow: /search/ Disallow: /author/ Disallow: /users/ Disallow: */trackback Disallow: */feed Disallow: */rss Disallow: */embed Disallow: /xmlrpc.php Disallow: *?utm Disallow: *openstat= Disallow: /tag/ Disallow: /readme.html Disallow: *?replytocom Allow: */uploads Allow: /*/*.js Allow: /*/*.css Allow: /wp-*.png Allow: /wp-*.jpg Allow: /wp-*.jpeg Allow: /wp-*.gif Sitemap: http://site.com/sitemap.xml #заменить на адрес вашей карты сайта

ROBOTS.TXT для OpenCart

В “админке” OpenCart нет встроенного инструмента для настройки robots.txt, поэтому доступ к файлу возможен только с помощью FTP.

Приведенный ниже пример может использоваться как стартовый набор robots.txt для сайтов на OpenCart, но не является универсальным и требует адаптации в зависимости сайта.

Пояснения:

- в директивах Allow указаны пути к файлам стилей, скриптов, картинок: для правильной индексации сайта необходимо, чтобы они были доступны роботам;

- разбиение на правила для разных агентов обусловлено тем, что Google не поддерживает директиву Clean-param;

ROBOTS.TXT для Joomla!

В “админке” Джумла нет встроенного инструмента для настройки robots.txt, поэтому доступ к файлу возможен только с помощью FTP.

Приведенный ниже пример может использоваться как стартовый набор robots.txt для сайтов на Joomla с включенным SEF, но не является универсальным и требует адаптации в зависимости сайта.

Пояснения:

- в директивах Allow указаны пути к файлам стилей, скриптов, картинок: для правильной индексации сайта необходимо, чтобы они были доступны роботам;

- разбиение на правила для разных агентов обусловлено тем, что Google не поддерживает директиву Clean-param;

Перечень основных агентов

| Бот | Функция |

| Googlebot | основной индексирующий робот Google |

| Googlebot-News | Google Новости |

| Googlebot-Image | Google Картинки |

| Googlebot-Video | видео |

| Mediapartners-Google | |

| Mediapartners | Google AdSense, Google Mobile AdSense |

| AdsBot-Google | проверка качества целевой страницы |

| AdsBot-Google-Mobile-Apps | Робот Google для приложений |

| YandexBot | основной индексирующий робот Яндекса |

| YandexImages | Яндекс.Картинки |

| YandexVideo | Яндекс.Видео |

| YandexMedia | мультимедийные данные |

| YandexBlogs | робот поиска по блогам |

| YandexAddurl | робот, обращающийся к странице при добавлении ее через форму «Добавить URL» |

| YandexFavicons | робот, индексирующий пиктограммы сайтов (favicons) |

| YandexDirect | Яндекс.Директ |

| YandexMetrika | Яндекс.Метрика |

| YandexCatalog | Яндекс.Каталог |

| YandexNews | Яндекс.Новости |

| YandexImageResizer | робот мобильных сервисов |

| Bingbot | основной индексирующий робот Bing |

| Slurp | основной индексирующий робот Yahoo! |

| Mail.Ru | основной индексирующий робот Mail.Ru |

Частые вопросы

Текстовый файл robots.txt является общедоступным, что следует учитывать, и не использовать данный файл как средство сокрытия конфиденциальной информации.

Есть ли отличия robots.txt для Яндекс и Google?

Принципиальных отличий в обработке robots.txt поисковыми системами Яндекс и Гугл нет, но все же следует выделить ряд моментов:

- как уже указывалось ранее правила в robots.txt носят рекомендательный характер, чем активно пользуется Google.

В документации по работе с robots.txt Google указывает , что “..не предназначена для того, чтобы запрещать показ веб-страниц в результатах поиска Google. “ и “Если файл robots.txt запрещает роботу Googlebot обрабатывать веб-страницу, она все равно может демонстрироваться в Google”. Для исключения страниц из поиска Google необходимо использовать мета-теги robots.

Яндекс же исключает из поиска страницы, руководствуясь правилами robots.txt.

- Яндекс в отличие от Google поддерживает директивы Clean-param и Crawl-delay.

- Роботы AdsBot Google не следует правилам для User-agent: *, для них необходимо задавать отдельные правила.

- Многие источники указывают, что файлы скриптов и стилей (.js, .css) нужно открывать для индексации только роботам Google. На самом деле это не соответствует действительности и следует открывать эти файлы и для Яндекс: с 9.11.2015 Яндекс начал использовать js и css при индексации сайтов (сообщение в официальном блоге).

Как закрыть сайт от индексации в robots.txt?

Чтобы закрыть сайт в Robots.txt нужно использовать одно из следующих правил:

User-agent: * Disallow: / User-agent: * Disallow: *

Возможно закрыть сайт только для какой-то одной поисковой системы (или нескольких), при этом оставив остальным возможность индексирования. Для этого в правиле нужно изменить директиву User-agent: заменить * на название агента, которому нужно закрыть доступ ().

Как открыть сайт для индексации в robots.txt?

В обычном случае, чтобы открыть сайт для индексации в robots.txt не нужно предпринимать никаких действий, просто нужно убедиться, что в robots.txt открыты все необходимые директории. Например, если ранее ваш сайт был скрыт от индексации, то следует удалить из robots.txt следующие правила (в зависимости от использованного):

- Disallow: /

- Disallow: *

Обратите внимание, что индексация может быть запрещена не только с помощью файла robots.txt, но и использованием мета-тега robots.

Также следует учесть, что отсутствие файла robots.txt в корне сайта означает, что индексация сайта разрешена.

Как указать главное зеркало сайта в robots.txt?

На данный момент указание главного зеркала с помощью robots.txt невозможно. Ранее ПС Яндекс использовала директиву Host, которая и содержало указание на основное зеркало, но с 20 марта 2018 Яндекс полностью отказался от ее использования. Сейчас указание главного зеркала возможно только с помощью 301-го постраничного редиректа.